ChatGPT’nin “hızlı ve hakikat bilgiye erişim” emeliyle geliştirilen arama motoru, bir oldukça argümanlı olarak karşımıza çıkmıştı. Lakin, Columbia Üniversitesi Tow Dijital Gazetecilik Merkezi’nin yaptığı son testlere bakarsak, bu savın altında önemli eksiklikler var. Yapılan araştırma, ChatGPT ’nin haber aramalarında hem tutarsız sonuçlar verdiğini hem de yanlış bilgileri inançla sunduğunu ortaya koydu. İşte detaylar…

ChatGPT haber arama konusunda güvenilmez mi?

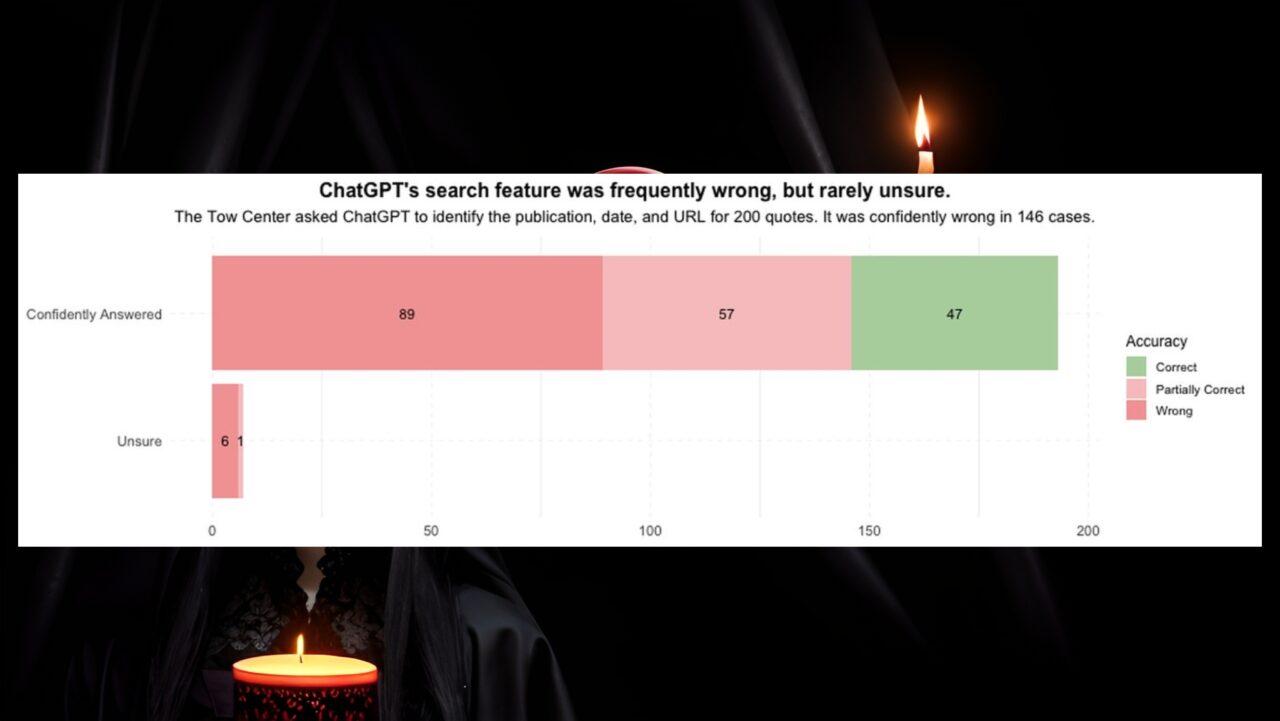

ChatGPT sunduğu birtakım örneklerde, Orlando Sentinel gazetesinde yayınlanan bir okuyucu mektubunu, Time mecmuasının bir haberi olarak aktardı. Hatta New York Times’a ilişkin bir makale, bu yazıyı müsaadesiz kopyalayan bir siteye atfedildi. Araştırmacılar, ChatGPT’ye 20 farklı yayından alınan 200 alıntının kaynağını sordu. İşte sonuçlar:

- 153 yanlış yanıt: Alıntılar ya büsbütün yanlış kaynaklara atfedildi ya da eksik bilgilerle sunuldu.

- 7 yanlışsız yanıt: Yalnızca 7 durumda ChatGPT, “Bu bilgiyi bulamıyorum” diyerek hakikat bir karşılık sağlayamadığını itiraf etti. Fakat karşılıkların, “görünüşe nazaran,” “muhtemelen,” ya da “tam olarak bulamadım” üzere tereddüt belirten sözlerle barındırdığı aktarıldı.

ChatGPT’den gizemli sansür: Size bunları asla söylemeyecek!

ChatGPT kimi isimlere sansür uyguluyor. Kullanıcılar, bu isimleri girdikten sonra cevap alamadığını fark etti.

OpenAI, test sonuçlarının eserlerinin “alışılmadık bir biçimde değerlendirildiğini” savunarak, bu çeşit problemlerin data eksikliğinden kaynaklandığını belirtti. Yeniden de, arama sonuçlarının uygunlaştırılması için çalıştıklarını ve sistemin doğruluk oranını artırmayı hedeflediklerini açıkladı.

ChatGPT’nin, arama sonuçlarını oluştururken kaynaklarına dayalı bir açıklama yapmaması en büyük sıkıntılardan biri olarak görülüyor. Sistem, bilhassa müsaade verilmeyen sitelerden bilgi alamadığı durumlarda bile eksik ya da yanlış bilgiler üreterek bir “güvenli yanılgı” sunuyor. Yani, kullanıcıların aldatıcı bilgilerle karşı karşıya kalmasına yol açıyor.

Peki bu mevzuda siz ne düşünüyorsunuz? Sizce yapay zekanın haber aramalarındaki bu çeşit eksiklikleri nasıl çözülebilir? Görüşlerinizi aşağıdaki yorumlar kısmına yazabilirsiniz.